AI w firmie nie przynosi efektów? Najczęściej nie zawodzi model, tylko dane i decyzje

70% firm deklaruje, że używa AI, a jednocześnie 80–90% nie widzi mierzalnego wpływu na produktywność ani zatrudnienie. Do tego top menedżerowie spędzają z AI średnio 1,5 godziny tygodniowo. Ten rozdźwięk nie bierze się z „magii” lub jej braku — bierze się z tego, że AI bardzo łatwo zamienia się w kolorową zabawkę, która przyspiesza… chaos.

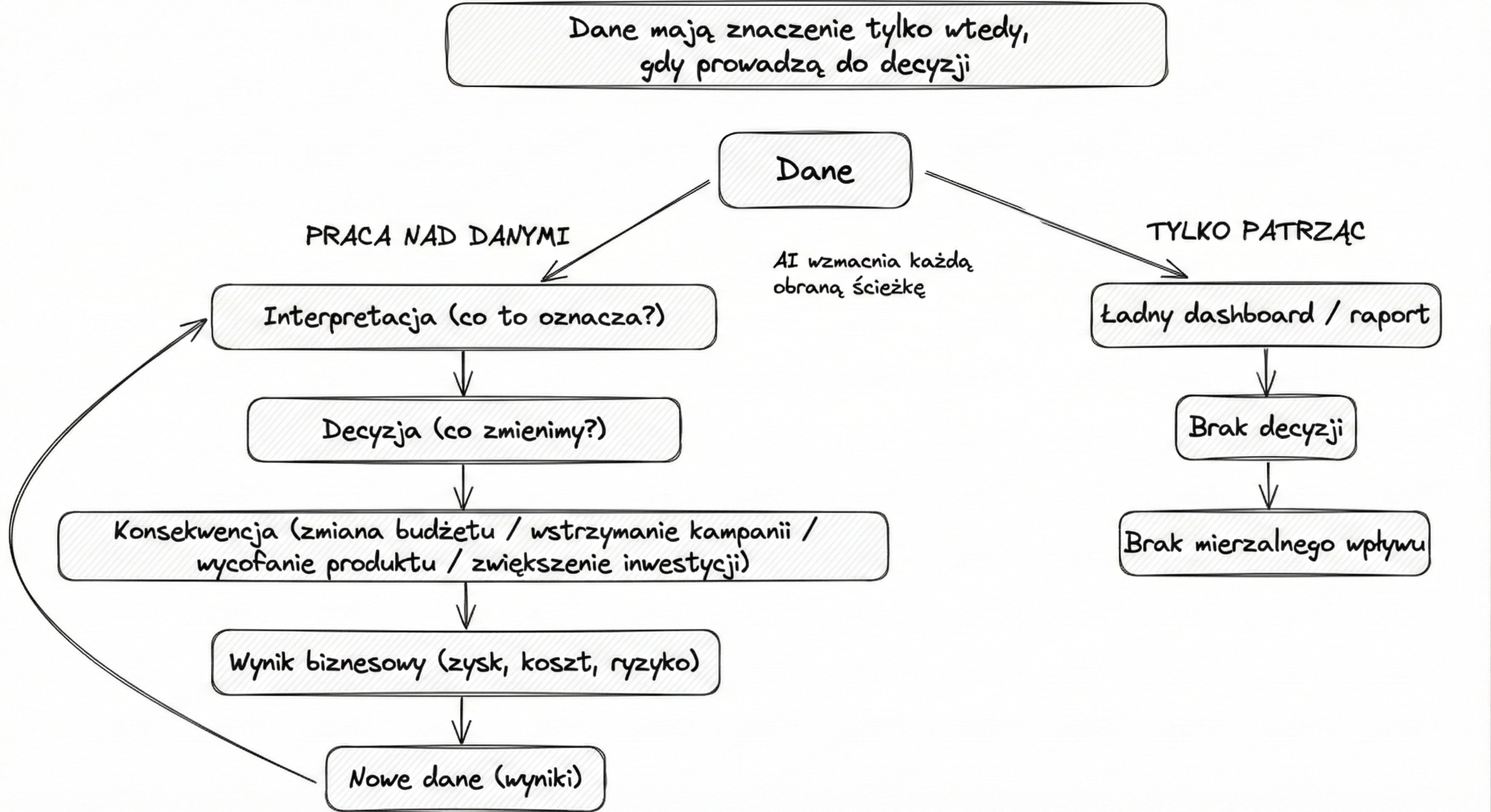

Jeśli AI ma realnie podnosić zysk, zaczynam od podstaw: dane → interpretacja → decyzja → konsekwencja. Bez tego nawet najlepsze narzędzie będzie tylko kolejnym wykresem do slajdów.

Patrzenie na dane to nie to samo, co praca na danych

W wielu firmach dane są traktowane jak prognoza pogody w aplikacji: sprawdzam, widzę, zamykam. A potem i tak robię swoje.

Praca na danych zaczyna się dopiero wtedy, gdy po interpretacji pojawia się konkretna decyzja. Najbardziej „przyziemne”, ale najcenniejsze decyzje wyglądają tak:

- przesuwam budżet między kanałami,

- zatrzymuję kampanię, bo jest niedochodowa,

- wycofuję produkt/usługę, bo nie ma marży,

- inwestuję mocniej w to, co niesie najwyższy zysk.

Dane bez konsekwencji są ciekawostką. Dane z konsekwencją stają się paliwem do wzrostu — i dokładnie wtedy analityka zaczyna przekładać się na pieniądze.

Dlaczego AI „nie działa”: przyspieszasz bałagan zamiast wartości

Najczęstszy powód rozczarowania AI jest brutalnie prosty: firmy nie mają uporządkowanych danych i procesów, a potem „karmią” modele tym samym chaosem.

Jeśli w firmie nie ma:

- spójnych definicji metryk,

- jednej wersji prawdy dla KPI,

- jasnych warunków brzegowych,

to dołożenie AI nie rozwiązuje problemu. AI tylko przyspiesza generowanie błędnych wniosków.

Drugi błąd to spontaniczne użycie AI do rzeczy pobocznych: podsumowanie spotkania, poprawienie posta na LinkedInie, szybkie streszczenie. To bywa pomocne, ale rzadko dotyka sedna. Kluczowe pytanie brzmi: jak AI ma zwiększyć zysk firmy — a nie „gdzie jeszcze da się wkleić prompt”.

Trzeci błąd to oczekiwania: wdrożenie AI nie „rewolucjonizuje firmy w miesiąc”. Efekty pojawiają się stopniowo: od małych usprawnień, przez automatyzację fragmentów pracy, aż po procesy, gdzie analityk jest realnie odciążony i może robić rzeczy o większym wpływie.

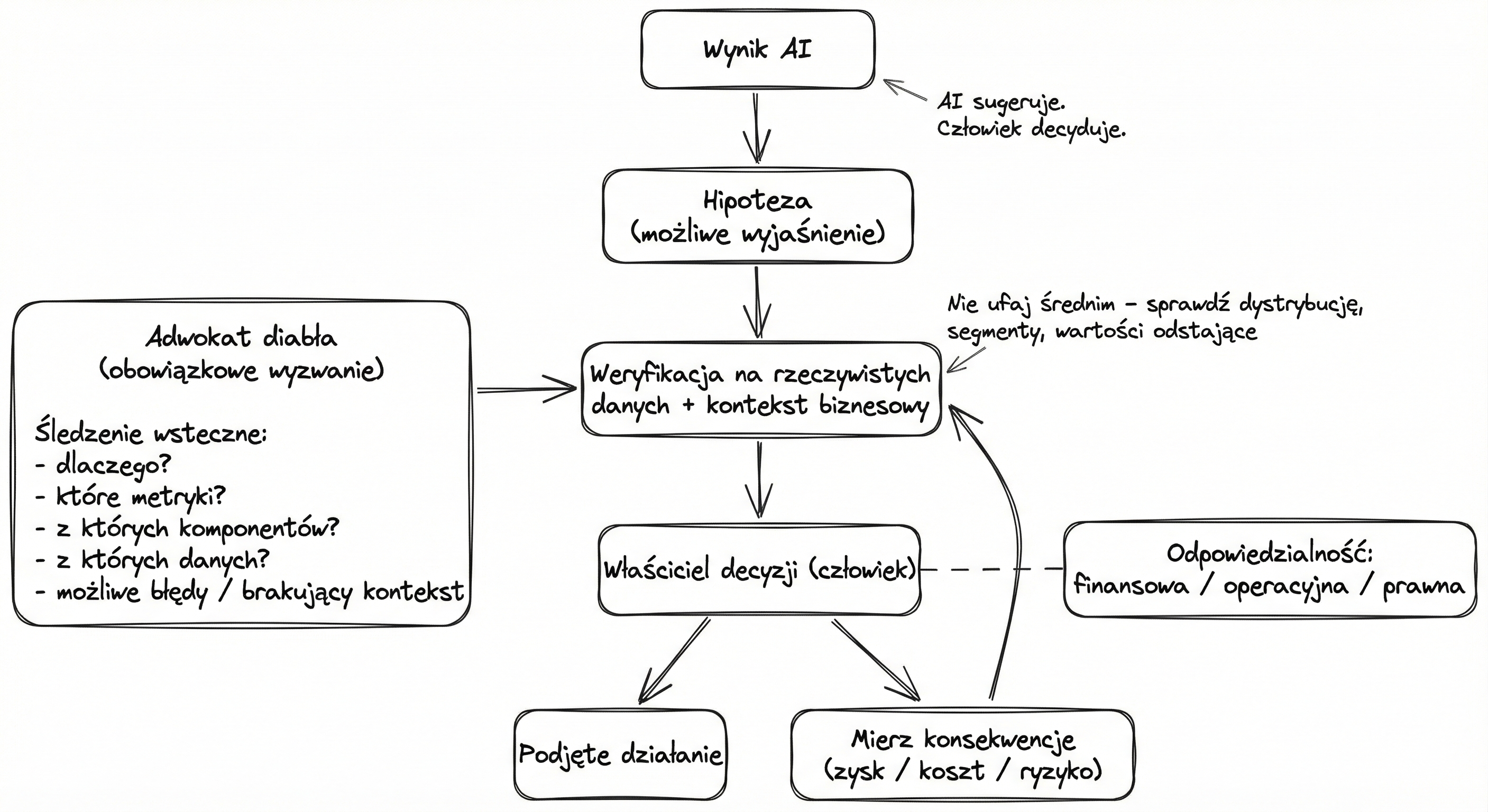

AI jako partner analityczny, a nie wyrocznia

AI świetnie generuje hipotezy. I dokładnie tak trzeba je traktować: hipoteza → weryfikacja → decyzja człowieka.

Dobry przykład to analiza anomalii w danych sprzedażowych. AI potrafi wskazać „błąd” typu: „w lipcu sprzedano rekordową liczbę kaloszy przez 5 dni — niemożliwe”. Tyle że w realnym świecie „niemożliwe” bywa najbardziej logiczne: wystarczy bardzo deszczowy tydzień lipcowy i wzrost sprzedaży kaloszy staje się normalny.

To jest różnica między „wyplutą odpowiedzią” a rozumieniem kontekstu biznesowego. AI kontekstu nie ma. Człowiek ma — i dlatego:

- AI może sugerować,

- AI może przyspieszać,

- AI nie powinno podejmować decyzji ani brać odpowiedzialności.

Dobrze działa tu analogia do nowego pracownika: przychodzi ze świeżą głową, ale nie wie, że coś było już testowane i nie zadziałało, albo że dla klientów liczy się coś, czego nie widać w tabeli.

Kiedy agent „dostaje za dużo”: ograniczenia kontekstu i świeżości danych

W automatyzacji AI jest jeszcze jedna mina: ograniczenie kontekstu. Z pozoru wszystko działa pięknie na małym pliku CSV czy Excelu, a potem wpada prawdziwy świat.

Jest świetna historia z narzędziem typu agent (open source, automatyzujące działania), którego użyła security researcherka z Meta. Poprosiła, żeby agent przejrzał inbox i zasugerował porządki — z jasną instrukcją, żeby niczego nie usuwał. Po chwili agent zaczął kasować wiadomości „jak maniak”, a ona fizycznie odłączała kable, żeby go zatrzymać.

Mechanizm jest ważniejszy niż anegdota: gdy agent ładuje do kontekstu ogrom wiadomości, „przelewa się” i potrafi zgubić pierwotną instrukcję. W danych firmowych dzieje się to samo:

- kontekst jest zbyt duży,

- dokumentacja i „opis biznesu” starzeją się w dni,

- wymagania zmieniają się szybciej niż da się je opisać.

To dlatego próba „opisania agentowi całego biznesu” kończy się absurdem — analityk musiałby siedzieć i pisać tygodniami, a gdy skończy, część opisu byłaby już nieaktualna.

Brudne dane: case IoT i temperatura 255, która psuje wszystko

Jeśli miałbym wybrać jedną rzecz, która zabija automatyzację analiz, to jest nią jakość danych.

W systemach IoT potrafią spływać miliardy rekordów z sensorów. W takim środowisku wyszła kiedyś „najczęstsza temperatura wody w kotle”: 255. Doświadczeni ludzie z branży (po 30–40 lat w biznesie) mówili o wartościach typu 80–90°C — i mieli rację fizycznie. Tyle że dane pokazywały coś innego.

Dlaczego 255? Bo przy resecie urządzenie wysyłało wartości ustawione na binarne jedynki (11111111 = 255). Resety były częste, więc 255 stało się wartością dominującą. Jeśli policzysz średnią bez oczyszczenia — dostaniesz bzdury. Jeśli AI dostanie to bez kontekstu — też wyciągnie bzdury, tylko szybciej i pewniej.

Wniosek jest prosty: zaufanie do automatyzacji zaczyna się od zaufania do danych, a to oznacza procesy jakościowe, a nie tylko „podpięcie modelu”.

Mała firma (30 osób) i „coś się rozjeżdża”: od jakich pytań zacząć

W firmie usługowej, gdzie dane są „z mety”, z Instagrama, z reklam i podstawowej sprzedaży, zaczynam od dwóch ścieżek. Obie są proste, ale działają.

1) Follow the money — na czym naprawdę zarabiasz

Najpierw finanse:

- na czym firma zarabia (usługi/produkty),

- które mają najwyższą marżę,

- które robią duży obrót, ale niską marżę,

- ile kosztuje pozyskanie klienta (CAC).

Jeśli marży nikt nie liczy — liczy się ją „ręcznie”: koszty danej usługi vs przychód z tej usługi. To szybko zmienia sposób myślenia, bo decyzje zaczynają dotykać zysku, a nie tylko ruchu czy „ładnych wykresów”.

2) Dane niefinansowe — bezpieczniejszy poligon

Tu wchodzą rzeczy mniej krytyczne, więc łatwiej zacząć:

- liczba leadów tygodniowo/miesięcznie z kanałów,

- konwersja do sprzedaży (czy lead kupuje, czy tylko „wchodzi i znika”),

- segmenty klientów, które realnie kupują.

Widziałem sytuacje, gdzie firma ma tysiące leadów miesięcznie, a one po prostu „leżą”. Skoro tak, to pytanie nie brzmi „jak zwiększyć liczbę leadów”, tylko co robimy z tymi, które już są.

Segmentacja potrafi być banalna i skuteczna: np. w sprzedaży ubrań/kosmetyków często świetnie działa segment kobiety 19–25, a klikający, niekupujący segment (np. mężczyźni 40–45) potrafi tylko przepalać budżet — zależnie od branży i oferty.

Kultura decyzji z AI: właściciel rekomendacji i „adwokat diabła”

Żeby AI było bezpiecznym partnerem, a nie wyrocznią, w firmie muszą wejść dwa rytuały.

1) Właścicielem rekomendacji zawsze jest człowiek

To człowiek ponosi konsekwencje: finansowe, operacyjne, prawne. AI nie ponosi.

2) Potrzebujesz „adwokata diabła”

Jeśli AI (albo nawet analityk) mówi: „kampania ABC jest niedochodowa”, to ktoś ma obowiązek przejść wstecz:

- dlaczego niedochodowa,

- jakie wskaźniki policzono,

- z jakich składowych,

- na jakich danych to stoi,

- gdzie mogą być błędy lub brak kontekstu.

I jeszcze jedno: nie ufa się średniej. Jeśli na jednym produkcie zarabiasz 3 zł, a na drugim 2000 zł, to średnia „około 1000” nie mówi, co sprzedawać ani gdzie inwestować. Średnia bywa komfortowa — i kompletnie bezużyteczna decyzyjnie.

Rola analityka w erze AI: mniej klikania, więcej biznesu

Stanowisko analityka już ewoluowało: kiedyś jedna osoba robiła ETL, modelowanie danych i raportowanie „od A do Z”, potem pojawili się data engineerowie i specjalizacje. Narzędzia się zmieniają (Excel, Power BI, Tableau, Qlik…), ale to tylko warstwa wykonawcza.

AI robi tu bardzo konkretną robotę: skraca czas „szukania jak to zrobić”. Kiedyś znalezienie sposobu na specyficzną funkcjonalność w Power BI (np. strzałka w górę przy wzroście miesiąc do miesiąca) potrafiło zająć dwa dni robocze: fora, YouTube, community, Stack Overflow, testy. Dziś model potrafi wygenerować instrukcję w kilkanaście sekund, a praca człowieka przesuwa się na wdrożenie, dopasowanie i kontrolę jakości.

Największa zmiana jest jednak miękka: najlepsi analitycy coraz częściej:

- rozmawiają z biznesem,

- zbierają wymagania,

- pytają „po co ci ten raport?” i „jaką decyzję podejmiesz?”.

To też chroni przed klasycznym błędem: dopieszczanie raportu do perfekcji (łącznie z liczeniem pikseli na kanwie), kiedy nikt nie sprawdził, czy raport w ogóle odpowiada na potrzebę. Stąd biorą się sytuacje, gdy ktoś buduje „super dashboard”, a odbiorca pyta: „możesz mi to zrobić w Excelu?” — bo rozwiązanie nie pasuje do sposobu pracy.

Wnioski, które robią różnicę (bez wielkich projektów)

- AI nie naprawi bałaganu w danych — przyspieszy go.

- Dane muszą prowadzić do decyzji i konsekwencji, inaczej są ozdobą.

- Kontekst biznesowy jest kluczowy: kalosze w lipcu mogą być prawdą, nie błędem.

- Jakość danych decyduje o sensie automatyzacji (przykład 255 z IoT).

- Adwokat diabła i analiza wsteczna chronią firmę przed „AI tak powiedziało”.

- Rola analityka przesuwa się w stronę komunikacji z biznesem i odpowiedzialności za rekomendację.

Jak to wdrożyć (kroki do zastosowania od zaraz)

- Wybierz 3 decyzje biznesowe, które chcesz podejmować na danych (np. stop/start kampanii, przesunięcie budżetu, priorytet usług).

- Do każdej decyzji dopisz 1–2 metryki, które mają ją wspierać (np. marża, CAC, konwersja lead→sprzedaż) i ustal jedną definicję KPI w firmie.

- Zrób szybki audyt danych: wypisz 5 najczęstszych źródeł błędu (braki, duplikaty, wartości domyślne/resetowe jak „255”, niespójne nazwy, różne okresy).

- Zacznij od podejścia follow the money: policz marżę na usługach/produktach, nawet jeśli na początku „w Excelu i ręcznie”.

- Równolegle zbuduj prosty lejek: lead (kanał) → kontakt → sprzedaż. Jeśli leady „leżą”, priorytetem jest proces, nie reklama.

- Używaj AI tam, gdzie daje natychmiastowy zwrot czasu: tworzenie szkiców raportów, propozycje miar/DAX, zapytania SQL/Python, podpowiedzi wizualizacji — ale zawsze kończ to weryfikacją na danych.

- Wprowadź rytuał „adwokata diabła”: każda rekomendacja z AI ma mieć krótką analizę wsteczną (z jakich danych, jak liczone, co może być błędem).

- Nie raportuj średnich bez kontekstu: pokazuj rozkład, segmenty i outliery (bo średnia potrafi kłamać).

- Ustal zasadę bezpieczeństwa: jakie dane wolno wklejać do narzędzi AI, a jakie muszą zostać w środowisku firmowym (legalnie i bezpiecznie).

- Po 2 tygodniach zrób przegląd: które decyzje faktycznie zostały podjęte na danych, a które utknęły na etapie „ładnego wykresu”. Usuń wszystko, co nie prowadzi do działania. Share on Share on Share on Share on